Supervised Learning (Prediksi)

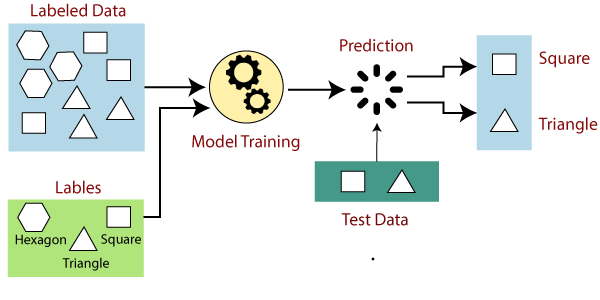

Supervised Learning adalah jenis pembelajaran mesin di mana model dilatih menggunakan data yang sudah diberi label. Ini berarti bahwa setiap contoh dalam dataset pelatihan memiliki input dan output yang sesuai. Tujuan dari supervised learning adalah untuk mempelajari hubungan atau pola dari data tersebut sehingga model dapat membuat prediksi yang akurat untuk data baru yang tidak terlihat sebelumnya.

Supervised learning dapat dibagi menjadi dua kategori utama:

1. Regresi: Memprediksi nilai kontinu.

2. Klasifikasi: Memprediksi kategori atau kelas dari data.

Algoritma Supervised Learning

Berikut adalah daftar 30 algoritma prediksi yang sering digunakan dalam supervised learning, dibagi berdasarkan kategori regresi dan klasifikasi:

Algoritma Regresi

1. Linear Regression

- Menggunakan hubungan linear antara input dan output untuk membuat prediksi nilai kontinu.

2. Ridge Regression

- Variasi dari linear regression dengan penalti L2 untuk mengurangi overfitting.

3. Lasso Regression

- Menggunakan penalti L1 untuk melakukan seleksi fitur dan mengurangi overfitting.

4. Polynomial Regression

- Memodelkan hubungan non-linear antara input dan output dengan menambahkan derajat polinomial.

5. Support Vector Regression (SVR)

- Memperluas konsep SVM untuk regresi, menjaga margin kesalahan dalam nilai tertentu.

6. Decision Tree Regression

- Menggunakan struktur pohon untuk membuat prediksi nilai kontinu berdasarkan fitur input.

7. Random Forest Regression

- Menggabungkan beberapa pohon keputusan untuk meningkatkan akurasi prediksi.

8. Gradient Boosting Regression

- Membuat model prediktif kuat dengan menggabungkan beberapa model prediksi lemah secara iteratif.

9. AdaBoost Regression

- Menggabungkan beberapa model prediksi lemah, menyesuaikan bobot berdasarkan kesalahan sebelumnya.

10. K-Nearest Neighbors Regression (KNN)

- Menggunakan tetangga terdekat dari titik data untuk membuat prediksi nilai kontinu.

11. Bayesian Ridge Regression

- Memperluas ridge regression dengan pendekatan Bayesian untuk menentukan distribusi parameter.

12. Elastic Net Regression

- Menggabungkan penalti L1 dan L2 untuk mengatasi masalah multikolinearitas.

13. Huber Regression

- Menggunakan fungsi kerugian yang robust terhadap outlier.

14. Quantile Regression

- Memprediksi kuantil atau persentil dari distribusi variabel target.

15. Principal Component Regression (PCR)

- Menggabungkan PCA dan regresi linear untuk mengatasi masalah multikolinearitas.

Algoritma Klasifikasi

16. Logistic Regression

- Menggunakan fungsi logit untuk memprediksi probabilitas kategori kelas biner.

17. Support Vector Machine (SVM)

- Mencari hyperplane optimal yang memisahkan kelas dalam ruang fitur.

18. Decision Tree Classification

- Menggunakan struktur pohon untuk membuat keputusan klasifikasi berdasarkan fitur input.

19. Random Forest Classification

- Menggabungkan beberapa pohon keputusan untuk meningkatkan akurasi klasifikasi.

20. Gradient Boosting Classification

- Membuat model prediktif kuat dengan menggabungkan beberapa model prediksi lemah secara iteratif.

21. AdaBoost Classification

- Menggabungkan beberapa model prediksi lemah, menyesuaikan bobot berdasarkan kesalahan sebelumnya.

22. K-Nearest Neighbors Classification (KNN)

- Menggunakan tetangga terdekat dari titik data untuk membuat keputusan klasifikasi.

23. Naive Bayes

- Menggunakan teorema Bayes dengan asumsi independensi antara fitur untuk klasifikasi.

24. Linear Discriminant Analysis (LDA)

- Menggunakan kombinasi linear dari fitur untuk memisahkan dua atau lebih kelas.

25. Quadratic Discriminant Analysis (QDA)

- Mirip dengan LDA tetapi memungkinkan batas keputusan non-linear.

26. Stochastic Gradient Descent (SGD)

- Menggunakan pendekatan iteratif untuk mengoptimalkan fungsi kerugian pada dataset besar.

27. Multilayer Perceptron (MLP)

- Jaringan saraf tiruan yang terdiri dari beberapa lapisan untuk menangani masalah non-linear.

28. Extreme Gradient Boosting (XGBoost)

- Versi yang dioptimalkan dari gradient boosting dengan efisiensi tinggi.

29. LightGBM

- Implementasi gradient boosting yang sangat cepat dan efisien untuk dataset besar.

30. CatBoost

- Algoritma boosting yang dirancang untuk menangani data kategori secara efektif.

Komentar

Posting Komentar